Pode parecer estranho e, de certa forma, forçado falar da expressão empatia artificial em tempos de hype de Inteligência Artificial. Isso por que até parecem termos que estão em sentidos completamente opostos: empatia e artificial. A empatia é um termo que nos remete ao humano, à capacidade de se colocar no lugar do outro ser humano. Ela implica em reconhecer emoções e se conectar emocionalmente às emoções dos outros. Já o termo artificial, no contexto atual, representa a automação de atividades humanas por meio de computadores. Entretanto, esta não parece ser uma área que esteja apenas surfando na onda da Inteligência Artificial. Na verdade, ela já vem sendo estudada desde 1995, quando Rosalind Picard, do MIT Media Lab, publicou “Affective Computing” e, mais recentemente, quando o primeiro artigo mencionando o termo Empatia Artificial foi publicado por Minoru Asada (link). Apesar disso, ainda está longe o consenso sobre se inteligências artificiais podem verdadeiramente reconhecer emoções humanas.

O que é a empatia artificial e quais são os desafios

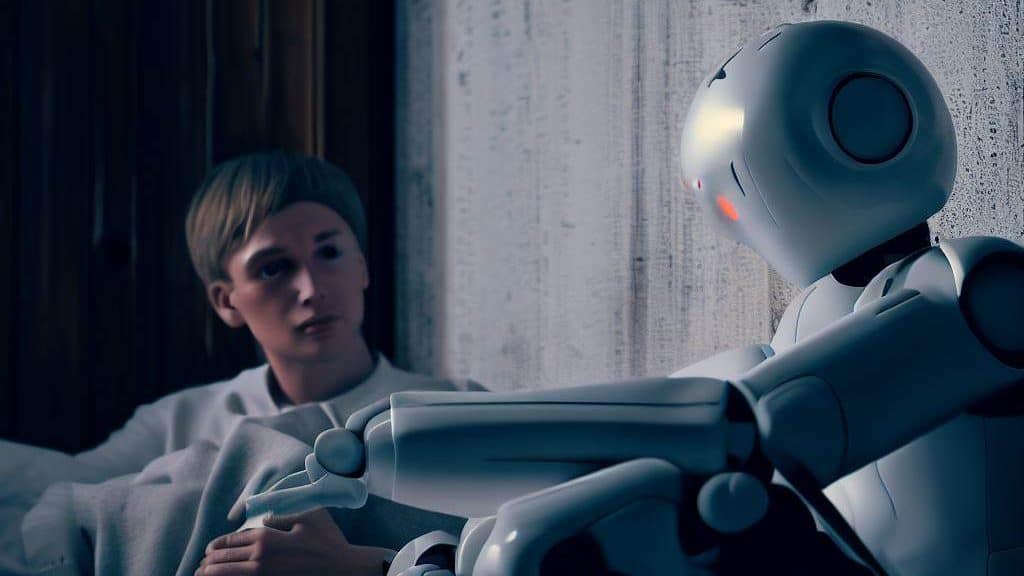

A empatia artificial difere da empatia humana da mesma forma que a inteligência artificial difere da inteligência humana. O conceito descreve a codificação da empatia nas máquinas, baseado em intenções apropriadas e adaptado a situações específicas. Isso significa reconhecer expressões faciais, padrões de tonalidade de voz, respiração, frequência cardíaca e interpretação de textos. Explicando assim parece simples, mas como codificar algo que nem nós, seres humanos, sabemos de fato como funciona? Alguns especialistas defendem a tese de que, assim como humanos aprendem a ser empáticos, as IA’s também podem aprender (link). Essa conclusão possui alguma verdade em seu entendimento. Afinal, diversos algoritmos são capazes de detectar expressões de felicidade, raiva ou angústia no rosto das pessoas. Mas essa é a parte “simples” do processo. A parte complicada, como explicado anteriormente, consiste em fazer uma máquina “entender” o que é angústia, tristeza ou raiva e “se colocar” na mesma posição da pessoa analisada. Mas como uma máquina pode se colocar no lugar de alguém, por exemplo, que sofreu crime de racismo se ela não sabe quais sentimentos estão envolvidos, em qual intensidade e em quais proporções?

Como é possível um computador “sentir”?

A compreensão de sentimentos humanos por parte de uma máquina é um desafio complexo e, embora as máquinas não possuam emoções como os seres humanos, ainda assim é possível desenvolver sistemas de IA capazes de reconhecer e interpretar expressões emocionais humanas. No caso do processamento de linguagem natural, por exemplo, algoritmos de IA podem ser treinados para identificar palavras-chave, padrões linguísticos e contextos que indicam estados emocionais em textos ou conversas. Da mesma forma, podemos usar a análise de voz para detectar modulações, entonações e outros traços vocais que indicam emoções.No entanto, faz-se necessário ressaltar que a compreensão de sentimentos humanos por parte das máquinas é limitada e, de alguma forma, pode ser imprecisa e/ou enviesada. A interpretação de emoções é altamente subjetiva e contextual, variando de pessoa para pessoa, além de envolver diversas outras variáveis. Ademais, como no exemplo citado de racismo, as emoções humanas são influenciadas por fatores individuais, culturais e contextuais, o que torna o processo de “entender” um sentimento humano uma tarefa desafiadora para as máquinas.

Quem são os pioneiros e o que estão fazendo?

Apesar de todos esses desafios, já existem empresas que disponibilizam aos seus clientes serviços de atendimento automatizado e empático. É o caso da empresa Emoshape e da Cyrano.ia. Ambas desenvolvem tecnologias capazes de aproximar a máquina das sensações humanas. No caso da segunda, a tecnologia em questão é um sistema baseado em empatia digital para auxílio à venda de veículos e que percebe a “direção” da conversa com o cliente e pode reagir de maneira a auxiliar o vendedor a escolher a melhor estratégia.

Nesse sentido, diversas outras aplicações podem utilizar essa abordagem, como em sessões de aconselhamento profissional, psicológico ou educacional. É possível imaginar um aluno vítima de bullying que não consegue conversar com o psicólogo da escola mas tem facilidade de “conversar” com um chatbot dotado de inteligência artificial e de empatia artificial. O objetivo não é substituir os humanos nessas tarefas, mas utilizar a tecnologia como um aliado no processo de auxílio emocional.

Um exemplo mais forte nesse sentido é o uso de IA com empatia artificial no auxílio e tratamento de paciente com demência. Segundo Cynthia Breazeal, o tratamento desses pacientes geralmente levam médicos e enfermeiros ao esgotamento mental (burn-out). Nesse contexto, essa ferramenta pode trabalhar junto aos médicos refinando dados importantes ao tratamento, junto aos enfermeiros, auxiliando o monitoramento dos pacientes e, junto dos pacientes, auxiliando-os a receber um tratamento mais empático. Entretanto, é inegável que ainda existem potenciais riscos ao uso de uma IA empática. Um exemplo é a compreensão de emoções em pessoas oriundas de diferentes culturas, como muçulmanos, orientais, ocidentais e africanos. O cérebro humano possui ruídos que influenciam o processo cognitivo e afetivo e, consequentemente, leva a resultados diferentes para cada um. Dessa forma, não é possível uniformizar a empatia como se todos devessem agir/reagir da mesma forma.

Conclusão

Diante dos desafios e limitações atuais, a empatia artificial se apresenta como um campo promissor com perspectivas futuras fascinantes. Imagine um assistente pessoal no seu celular que seja capaz de te auxiliar emocionalmente em um momento desafiador! Ou um mundo em que chatbots, assistentes virtuais e sistemas de atendimento automatizado sejam capazes de compreender e responder às emoções dos usuários de forma genuína e compassiva. Isso poderia criar um ambiente digital mais acolhedor, oferecendo suporte emocional e ajudando a combater a solidão, o isolamento e outros desafios emocionais que enfrentamos em nosso cotidiano. Para isso, é necessário que as pesquisas avancem no desenvolvimento de uma empatia artificial ética e responsável, a fim de garantir que possamos utilizar a empatia artificial para o nosso benefício, respeitando valores fundamentais como inclusão, diversidade e justiça.

Portanto, é necessário encorajar e apoiar a exploração contínua da empatia artificial, principalmente incentivando parcerias entre a academia, a indústria e a sociedade civil. Assim, será possível moldar uma sociedade mais empática, onde a tecnologia se alia à nossa humanidade, ampliando nossa capacidade de nos conectarmos e entendermos uns aos outros, abrindo portas para um futuro em que a tecnologia possa verdadeiramente contribuir para o crescimento humano.

Laiton Garcia

Gostei do artigo, ele traz um debate muito interessante sobre a empatia artificial, fico curioso também sobre a Ética em IA. Como as máquinas aprendem a partir dos dados que são alimentados a elas, discutir como prevenir e mitigar vieses em IA seria uma conversa valiosa, ligando à questão da empatia artificial. Também sobre a Privacidade e IA, como acontece a coleta de dados, pois parece que isso seja crucial para a IA funcionar efetivamente. Discutir sobre como os dados dos usuários são protegidos durante o processo poderia ser um excelente ponto de discussão.

Ricardo Sekeff

Muito obrigado, prof. Essa discussão sobre o uso dos dados dos usuários nas IA’s é o ponto chave na discussão que o mundo vem promovendo. As IA’s, hoje, ainda são uma caixa-preta quanto ao que fazem com os dados e isso tem gerado muito desconforto entre os produtores de conteúdo. Tem um artigo de 2020 muito bom de Stanford que traz essa discussão à luz do estado da arte da época.

Artigo